클로드 API + 로컬 LLM 혼합 아키텍처는 비싼 API를 모든 요청에 쓰지 않고, 캐시·프록시·모델 라우팅으로 필요한 요청에만 Claude를 쓰게 만들어 비용을 크게 줄이는 방식입니다.

핵심은 반복 요청은 캐시, 단순 작업은 로컬 LLM, 고위험·고난도 작업만 Claude API로 보내는 설계입니다. 운영 지표를 함께 측정하면 품질을 유지하면서도 50~80% 절감 전략을 현실적으로 실행할 수 있습니다.

목차

- 1. Claude API 토큰 비용과 비용 최적화 관점

- 2. 클로드 API + 로컬 LLM 혼합 아키텍처 개요

- 3. 모델 라우팅 기준 정하기

- 4. 캐싱 설계로 Claude 호출 줄이기

- 5. LLM 프록시와 중앙 게이트웨이 설계

- 6. 로컬 LLM 인프라 선택 기준

- 7. 프롬프트·컨텍스트 최적화

- 8. 실제 서비스 적용 예시

- 9. 비용 모니터링과 최적화 루프

- 10. 로컬 LLM의 한계와 트레이드오프

- 자주 묻는 질문

많은 팀이 초기에는 Claude API를 직접 붙여 빠르게 출시합니다. 하지만 사용량이 늘면 입력 토큰, 출력 토큰, 긴 시스템 프롬프트, 누적 대화 히스토리까지 모두 비용으로 쌓이기 시작합니다. 그래서 클로드 API + 로컬 LLM 혼합 아키텍처는 단순한 최적화 기법이 아니라, 성장 이후를 대비하는 운영 구조에 가깝습니다.

이 글은 클로드 API 비용 절감을 위한 캐싱·프록시 패턴을 중심으로, 어떤 요청을 캐시하고 어떤 요청을 로컬 LLM에 넘기며 어떤 요청만 Claude API로 보낼지 실전 관점에서 정리합니다. 핵심은 늘 같습니다. 모든 요청에 최고급 모델을 쓰지 않는 것입니다.

1. Claude API 토큰 비용과 비용 최적화 관점

비용은 길이와 반복에서 급격히 커집니다

Claude API는 기본적으로 입력 토큰과 출력 토큰의 합에 따라 과금됩니다. 즉, 답변 품질이 높다고 비용이 오르는 것이 아니라, 더 긴 문맥을 자주 보내고 더 긴 답변을 자주 받는 구조일수록 비용이 먼저 커집니다.

특히 긴 시스템 프롬프트, 대화 전체 히스토리, 툴 호출 결과를 매번 함께 보내는 서비스는 체감보다 훨씬 빠르게 비용이 증가합니다. 그래서 비용 최적화는 모델 교체만으로 해결되지 않고, 요청 구조를 다시 설계해야 합니다.

핵심 질문: 이 요청은 정말 Claude가 필요한가, 이미 비슷한 응답을 만든 적이 있는가, 로컬 모델로 먼저 처리해도 되는가.

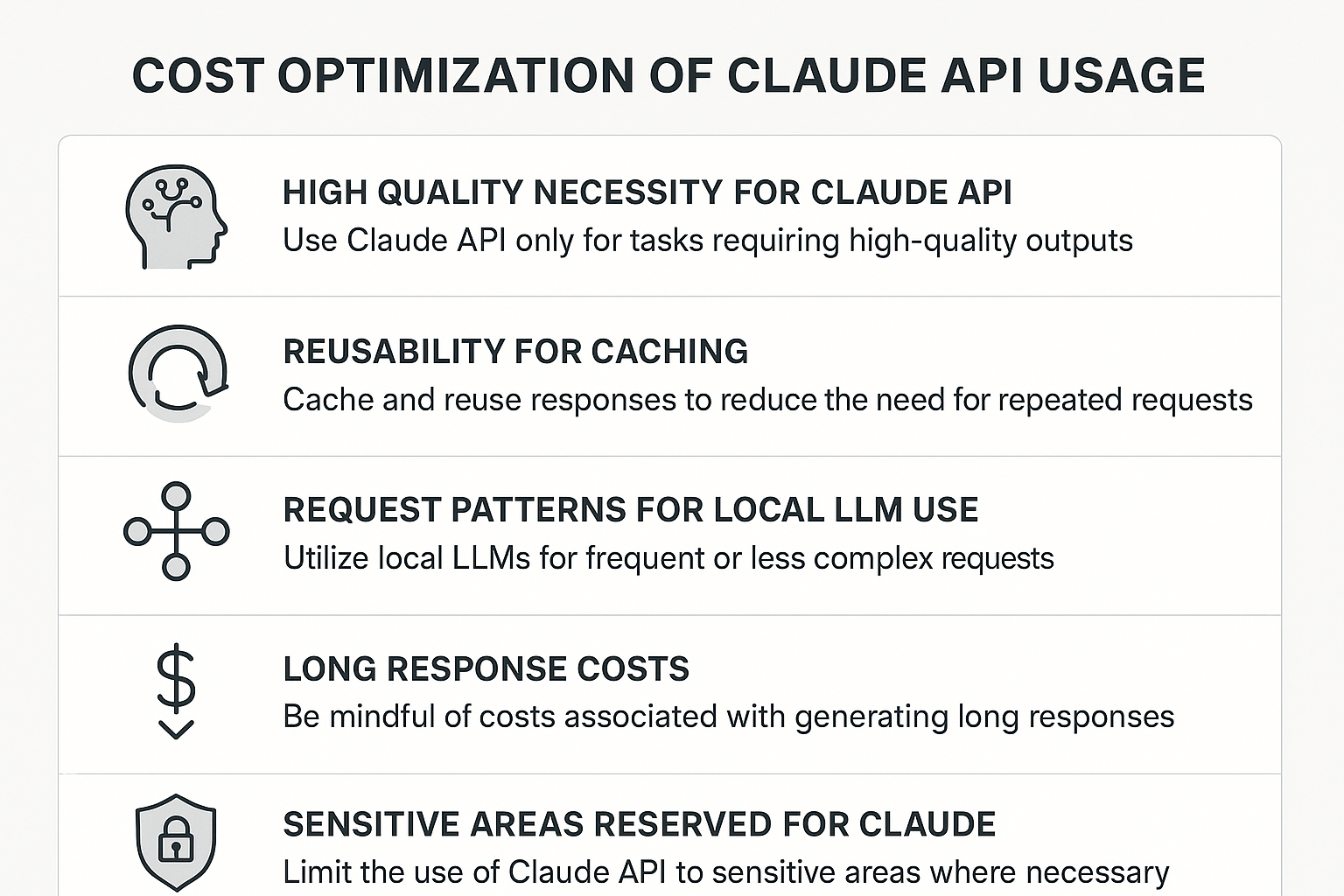

처음 점검할 체크리스트

- 고품질 필수 여부: 복잡한 추론, 중요한 코드 리뷰, 의사결정은 Claude API 우선

- 재사용 가능성: FAQ, 정책 안내, 배송 문의는 캐시 우선

- 요청 패턴: 짧고 반복적인 질의는 로컬 LLM 우선

- 응답 길이: 장문일수록 토큰 비용 영향이 커짐

- 위험도: 보안, 약관, 민감한 민원은 Claude 비중 유지

예를 들어 배송은 언제 오나요? 같은 질문은 재사용성이 높아 캐시에 잘 맞습니다. 반면 환불 거절이 약관상 적법한가요? 같은 질문은 더 높은 정확도와 맥락 이해가 필요하므로 Claude API가 적합합니다. 결국 비용 최적화는 무엇을 Claude API에, 무엇을 로컬 LLM에, 무엇을 캐시에 맡길지 정하는 일입니다.

2. 클로드 API + 로컬 LLM 혼합 아키텍처 개요

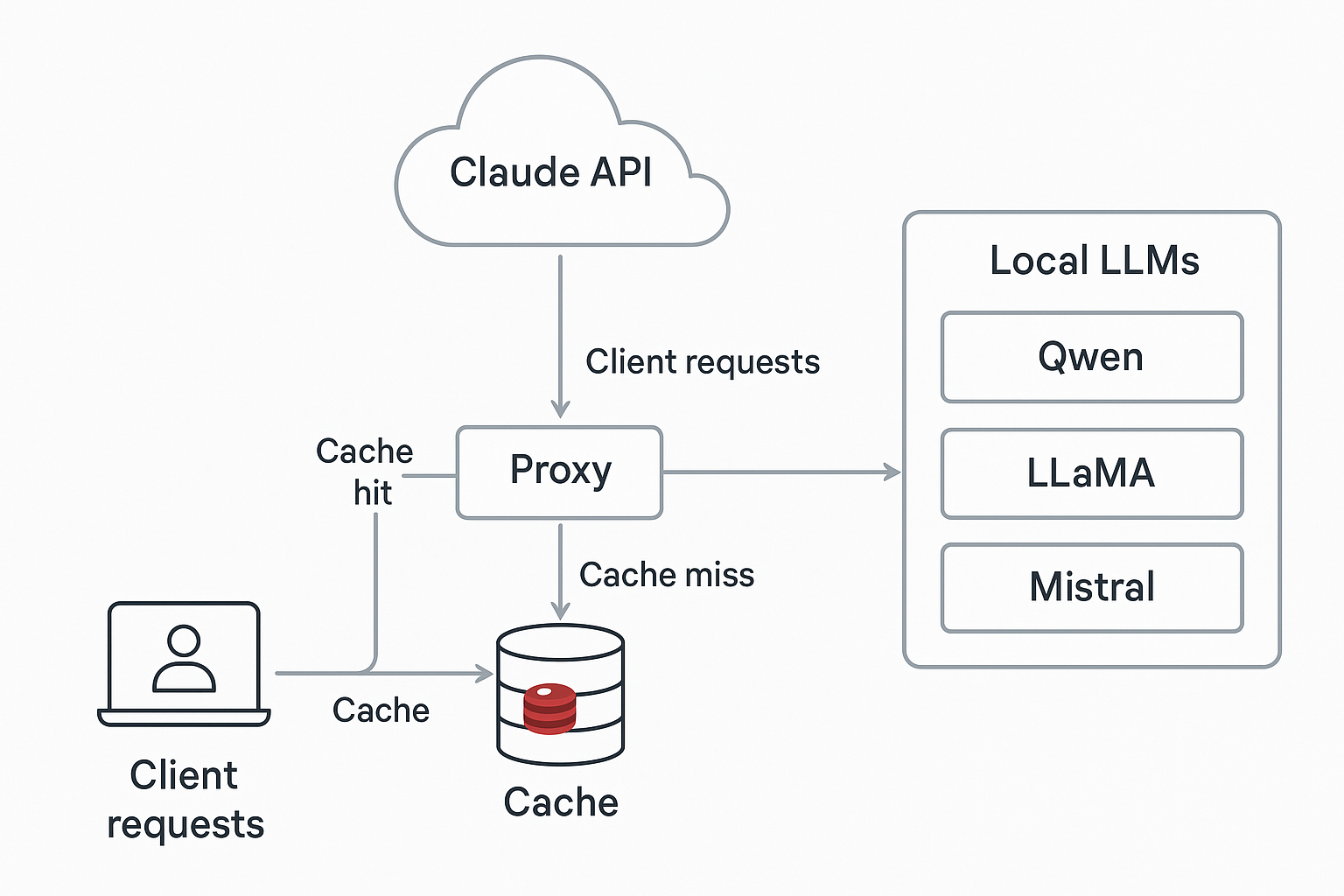

클로드 API + 로컬 LLM 혼합 아키텍처는 로컬에서 실행하는 오픈소스 모델과 Claude API를 함께 운용하는 방식입니다. 로컬 LLM은 Ollama, vLLM, llama.cpp 같은 도구로 서빙하고, 고난도 작업이나 고위험 요청만 Claude로 보내는 구조가 일반적입니다.

이 구조를 쓰면 서비스 코드는 모델별 차이를 직접 알 필요가 없습니다. 모든 요청을 프록시나 게이트웨이에서 받아 캐시를 먼저 보고, 난도를 판단하고, 적절한 모델로 라우팅하면 됩니다. 운영 복잡도는 조금 늘지만, 비용과 통제력 측면에서 얻는 이익이 큽니다.

클라이언트 → LLM 프록시/게이트웨이

↓

캐시 조회

HIT 반환 / MISS 진행

↓

모델 라우터

↙ ↘

로컬 LLM Claude API

↓

필요 시 로컬 전처리 → Claude → 로컬 후처리핵심 컴포넌트 5가지

- 요청 분류기: 룰 기반 또는 소형 모델로 난도와 위험도 판단

- 캐시 레이어: Redis, 메모리 캐시, DB 캐시로 반복 호출 제거

- LLM 라우터: 어떤 모델을 쓸지 결정

- 로컬 LLM 서버: Ollama, vLLM, llama.cpp 기반 실행

- Claude API 래퍼: 호출 형식, 로깅, 예산 제어 표준화

3. 모델 라우팅 기준 정하기

모델 라우팅은 이 아키텍처의 핵심입니다. 기준 없이 운영하면 결국 간단한 질문에도 비싼 모델을 계속 부르게 됩니다. 실무에서는 보통 정확도, 위험도, 복잡도, 재사용 가능성, 민감도 다섯 가지 기준으로 나눕니다.

어떤 작업을 어디에 보낼까

- 로컬 LLM 적합: 단순 요약, FAQ 응답, 라벨링, 스타일 변환, 반복 번역, 초안 작성

- Claude API 적합: 복잡한 추론, 민감한 상담, 예외 케이스 처리, 설계 리뷰, 보안 검토

예를 들어 코드 리뷰 SaaS라면 함수 설명, 변경 요약, 파일 구조 정리는 로컬 LLM으로 충분한 경우가 많습니다. 반면 보안 취약점 추론, 아키텍처 개선 제안, 애매한 버그 원인 분석은 Claude API가 더 적합합니다. 교육 챗봇도 마찬가지입니다. 쉬운 개념 설명은 로컬, 고난도 증명이나 창의 문제 해설은 Claude로 나누면 됩니다.

실제 절감 효과는 Claude 사용 비율을 얼마나 낮추느냐에 따라 크게 달라집니다. 단순 작업을 로컬로 전환해 Claude 비중을 60%에서 20% 수준으로만 줄여도, 이후 캐시와 프롬프트 최적화를 더하면서 절감 폭이 빠르게 커집니다.

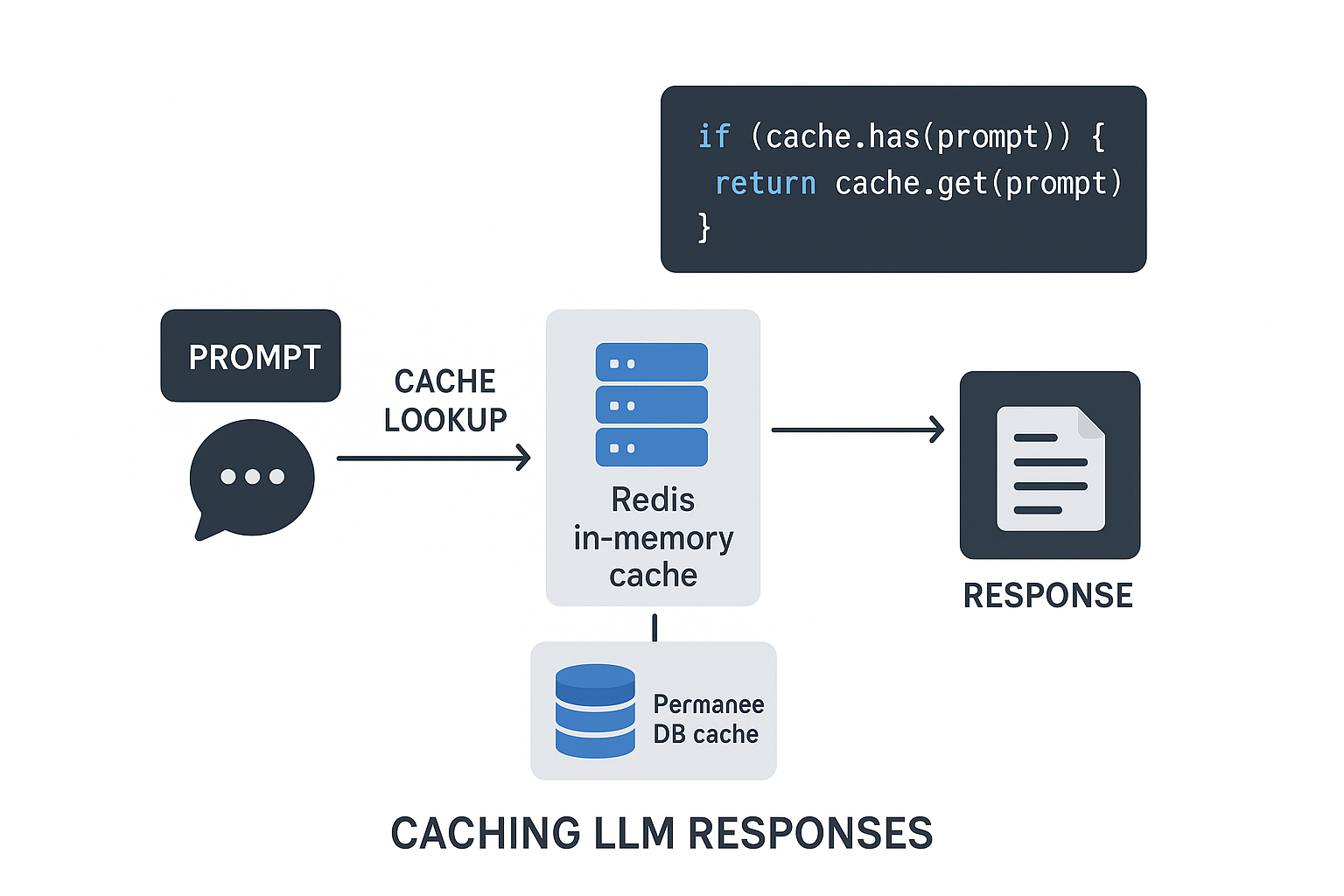

4. 캐싱 설계로 Claude 호출 줄이기

클로드 API 비용 절감을 위한 캐싱·프록시 패턴 중 가장 빠르게 체감되는 것은 캐싱입니다. FAQ, 정책 안내, 배송 질문, 일정한 템플릿을 따르는 질의는 응답 재사용 가능성이 높아 캐시 효율이 좋습니다.

캐시 키와 TTL이 성능을 좌우합니다

hash(prompt): 가장 단순한 시작hash(normalize(prompt)): 이름, 날짜, 공백 같은 차이를 정규화hash(intent + language + mode): 의미 중심 캐시 설계

TTL은 콘텐츠 특성에 따라 다르게 잡아야 합니다. 정책 문구, 운영 안내, 배송 기본 정보처럼 자주 변하지 않는 응답은 1시간에서 24시간 정도가 실용적입니다. 모델 버전이 바뀌면 캐시 네임스페이스를 분리해 한 번에 무효화하는 방식이 운영에 편합니다.

반복 요청 비율이 높을수록 캐시는 가장 강력한 절감 수단입니다. 전체 요청 중 반복 질의가 크다면 캐시 히트율 30~70%도 충분히 노릴 수 있고, 그만큼 Claude 호출이 직접 줄어듭니다.

def handle_request(prompt):

key = hash(normalize(prompt)) # 의미 없는 차이를 줄여 키 생성

cached = redis.get(key)

if cached:

return cached # HIT: Claude 호출 없음

response = route_and_call(prompt) # 로컬 LLM 또는 Claude API

redis.setex(key, 3600, response) # TTL 1시간

return response실무에서는 완전 일치 캐시만 보지 말고, 유사 캐시 + 로컬 보정 패턴도 고려할 만합니다. 비슷한 답변을 찾아 로컬 LLM이 이름, 날짜, 톤 정도만 바꾸면 Claude 호출 없이도 충분히 자연스러운 응답을 만들 수 있습니다.

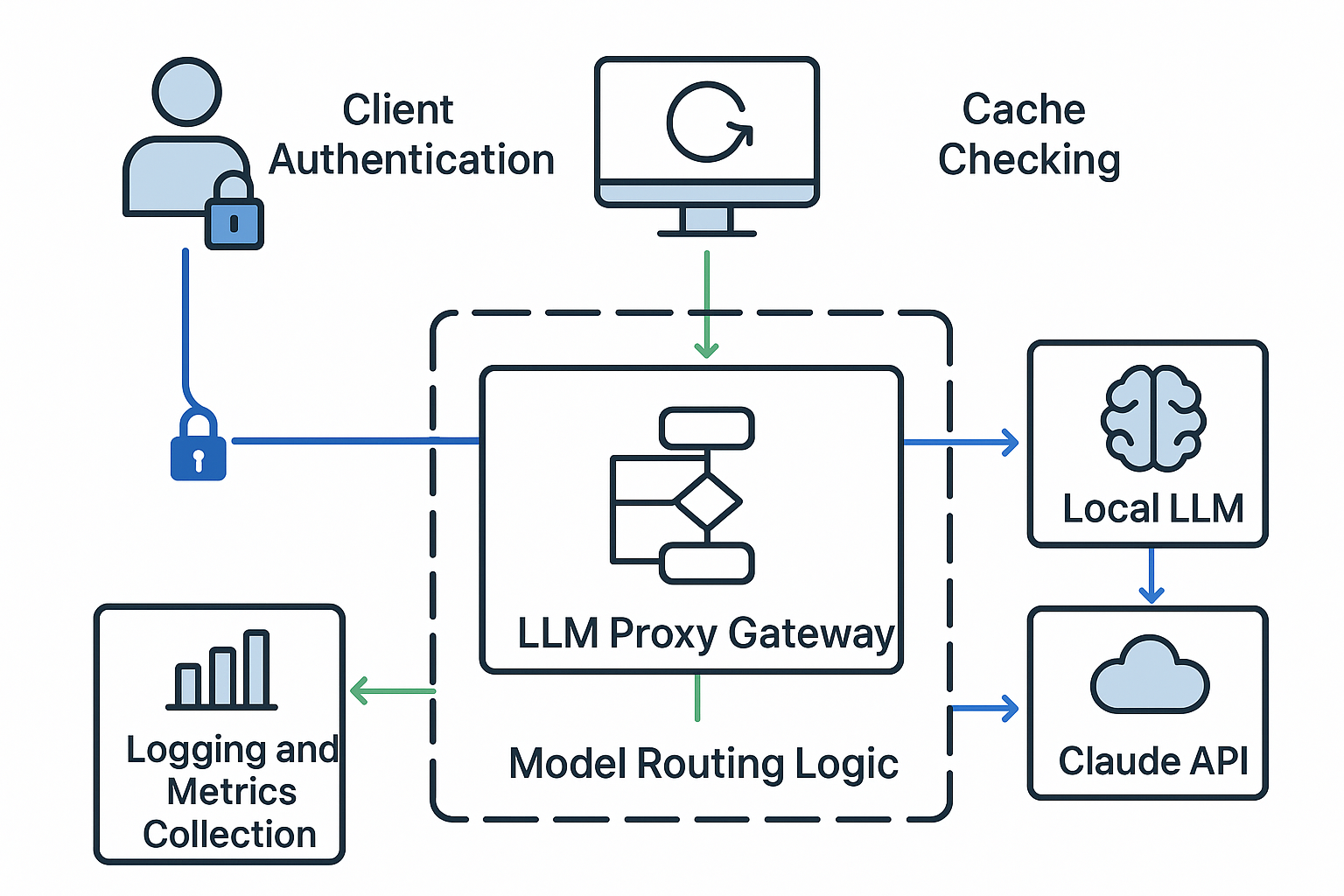

5. LLM 프록시와 중앙 게이트웨이 설계

프록시를 두는 이유는 서비스 코드가 여기저기서 Claude API를 직접 호출하지 않게 만들기 위해서입니다. 모든 요청을 중앙 프록시로 모으면 인증, 캐싱, 라우팅, 예산 상한, 로그, 폴백 전략을 한곳에서 제어할 수 있습니다. 이것이 클로드 API 비용 절감을 위한 캐싱·프록시 패턴의 두 번째 축입니다.

Client → LLM Proxy API

→ 인증

→ 캐시

→ 모델 라우팅

→ 로컬 LLM 또는 Claude API 호출

→ 로깅/메트릭

→ 응답중앙 프록시에서 반드시 처리할 것

- 인증과 권한

- 캐시 조회 및 저장

- 모델 라우팅

- 예산 상한과 레이트 리밋

- 민감정보 마스킹

- 모델별 로그와 메트릭 수집

라우팅은 보통 룰 기반과 소형 모델 분류를 함께 씁니다. 예를 들어 /bulk_summarize는 무조건 로컬 LLM으로 보내고, 애매한 자유질문은 먼저 소형 로컬 모델이 고난도 여부를 판단하게 할 수 있습니다.

@app.post("/generate")

def generate(req):

auth(req)

key = make_cache_key(req)

if cache.exists(key):

return cache.get(key)

model = route_request(req) # 로컬 or Claude

resp = call_model(model, req)

log_metrics(model=model, tokens=len(req.prompt))

cache.set(key, resp, ttl=3600)

return resp또한 무료 플랜 사용자는 하루 Claude 토큰 한도를 넘기면 자동으로 로컬 LLM만 사용하게 하고, 유료 사용자는 고품질 모델 접근을 허용하는 방식도 프록시에서 쉽게 구현할 수 있습니다. 즉, 프록시는 단순 중계기가 아니라 운영 통제 계층입니다.

6. 로컬 LLM 인프라 선택 기준

로컬 LLM은 목적별로 골라야 합니다. 모든 작업을 하나의 모델로 해결하려고 하면 속도도 품질도 비용도 애매해집니다. 중요한 기준은 태스크 적합성, 동시성, 메모리 요구량, 운영 난도입니다.

도구별 특징

- Ollama: 개인 개발자와 소규모 팀이 시작하기 가장 쉬움

- vLLM: GPU 서버 환경에서 고성능과 동시 요청 처리에 강함

- llama.cpp: CPU 중심 환경이나 경량 배포에 유리

모델 계열도 태스크에 맞춰 나누면 좋습니다. 요약·분류는 비교적 작은 Qwen이나 Gemma 계열로도 충분한 경우가 많고, 코딩 보조는 Mistral 계열이나 코드 특화 모델이 잘 맞는 경우가 있습니다. 일반 대화나 단순 안내는 Llama 계열도 무난합니다.

def generate(model: str, prompt: str):

if model.startswith("local"):

return ollama_client.generate(prompt)

if model.startswith("claude"):

return claude_client.generate(prompt)여기서 중요한 것은 모델 자체보다 모든 모델을 동일한 인터페이스로 감싸는 것입니다. 그래야 프록시에서 손쉽게 교체, 폴백, 버전 테스트를 할 수 있습니다.

7. 프롬프트·컨텍스트 최적화

프롬프트 최적화는 가장 싸고 빠른 절감 수단입니다. 시스템 프롬프트에 들어 있는 브랜드 설명, 긴 예시, 중복 규칙을 줄이고 핵심 규칙만 남기면 바로 토큰 사용량을 낮출 수 있습니다. 긴 컨텍스트를 잘 처리하는 모델이라도, 길게 넣을수록 비용은 늘어납니다.

효과가 큰 네 가지 방법

- 히스토리 요약: 전체 대화 대신 마지막 N턴과 요약본만 전달

- 로컬 요약 후 전달: 로컬 LLM이 먼저 긴 문서를 압축

- 구조화 입력: 자유문장보다 JSON 또는 key-value 사용

- 출력 제한:

max_tokens와 낮은 temperature 설정

예를 들어 자유 문장으로 길게 설명하는 대신 task_type, language, tone 같은 필드를 보내면 컨텍스트 길이를 크게 줄일 수 있습니다. 긴 문서도 먼저 로컬 LLM이 요약하고, 그 요약본만 Claude API에 전달하면 품질을 유지하면서 비용을 줄일 수 있습니다.

8. 실제 서비스 적용 예시

예시 1. AI 코드 리뷰 SaaS

사용자가 GitHub PR URL을 입력하면, 로컬 LLM이 먼저 변경 파일 구조와 핵심 diff를 요약합니다. 동일한 PR이나 커밋 해시는 캐시에 저장해 재분석을 피하고, 사용자가 심층 리뷰를 요청한 경우에만 Claude API로 보냅니다. 마지막 단계에서 로컬 LLM이 응답 톤을 친절형, 핵심형으로 바꿔 보여줄 수 있습니다.

이 구조는 Claude API가 가장 잘하는 부분만 맡기고, 나머지는 로컬과 캐시가 처리하도록 나눈 예시입니다. 클로드 API 비용 절감을 위한 캐싱·프록시 패턴이 실제 제품에서 가장 자연스럽게 동작하는 형태이기도 합니다.

예시 2. 교육용 챗튜터

초급 개념 설명, 정의, 짧은 예시 문제는 로컬 LLM이 처리합니다. 증명형 문제, 창의 문제 풀이, 민감한 학습 피드백만 Claude API로 올립니다. 인기 질문은 캐시에 저장하고, 로컬 LLM이 학생 수준에 맞게 다시 쉽게 설명하도록 설계하면 초급 트래픽 대부분을 로컬에서 흡수할 수 있습니다.

실전 포인트: Claude는 정답률과 섬세한 판단이 필요한 순간에만 쓰고, 반복성과 대량성은 로컬과 캐시가 맡게 하라.

9. 비용 모니터링과 최적화 루프

좋은 구조도 측정하지 않으면 오래 유지되지 않습니다. 하이브리드 구조에서는 최소한 모델별 호출량, Claude API 토큰 수, 평균 응답 시간, 오류율, 캐시 히트율을 계속 기록해야 합니다. 어떤 엔드포인트가 Claude를 과하게 쓰는지 보이지 않으면 최적화도 막연해집니다.

주간 리포트에서 볼 항목

- 캐시 HIT율이 낮은 엔드포인트의 키 설계와 TTL 조정

- Claude 사용 비율이 높은 태스크의 라우팅 재검토

- 응답 품질 저하 시 로컬 모델 업그레이드 또는 Claude 비중 조정

A/B 테스트도 중요합니다. 일부 트래픽에만 더 공격적인 로컬 우선 경로를 적용해 만족도와 정답률을 비교하면, 비용과 품질 사이 최적점을 빠르게 찾을 수 있습니다. 측정하고, 조정하고, 다시 측정하는 루프가 없으면 혼합 아키텍처는 오래 버티기 어렵습니다.

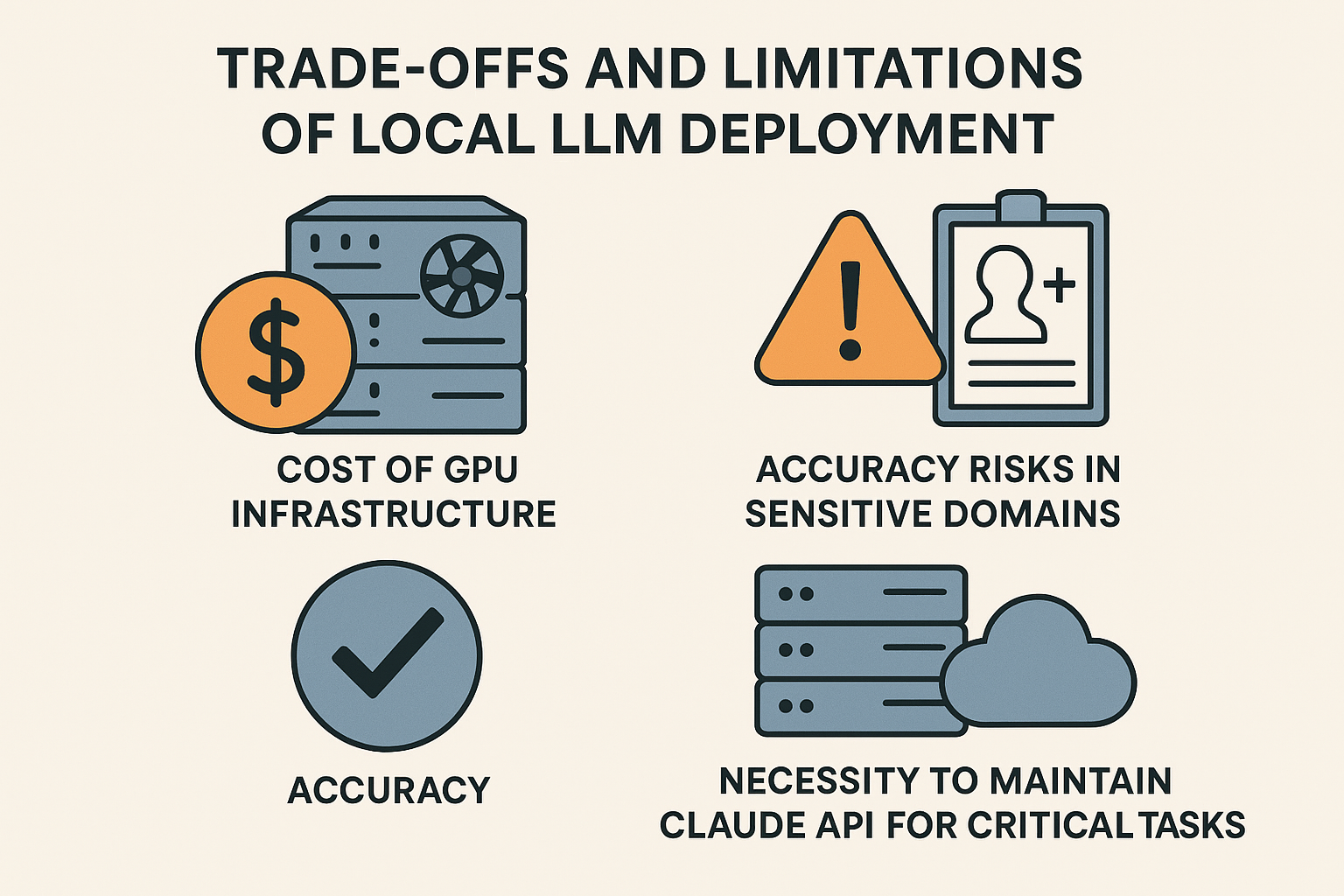

10. 로컬 LLM의 한계와 트레이드오프

로컬 LLM은 비용 절감에 매우 유용하지만 만능은 아닙니다. 의료, 법률, 금융처럼 실수 비용이 큰 영역은 Claude API 비중을 일정 수준 유지해야 합니다. 비용보다 정확도와 책임성이 더 중요한 구간이 분명 존재합니다.

또 하나의 현실적 변수는 인프라 비용입니다. GPU 서버 임대료, 운영 시간, 전력, 장애 대응까지 포함하면 API 비용보다 총비용이 높아질 수 있습니다. 반대로 작은 인프라 비용으로 더 큰 API 비용을 줄일 수 있다면 충분히 도입 가치가 생깁니다. 중요한 것은 토큰 비용만 보지 말고 총소유비용 관점으로 판단하는 것입니다.

개인정보 보호와 데이터 국외 반출 규정도 함께 고려해야 합니다. 민감 정보를 프록시에서 마스킹한 뒤 Claude API로 보내고, 원문은 내부 시스템에만 남기도록 설계하는 방식이 실무에서 자주 쓰입니다.

바로 실행할 3단계

정리하면, 클로드 API + 로컬 LLM 혼합 아키텍처의 핵심은 태스크를 나누고, 캐시를 먼저 보고, 프록시에서 모델 라우팅을 통제하는 것입니다. 여기에 프롬프트 최적화와 모니터링을 더하면 비용은 한 번 더 줄어듭니다.

- 현재 Claude API 사용 패턴 파악: 모델별 호출량, 월 비용, 토큰 비중을 먼저 대시보드로 확인합니다.

- LLM 프록시 + 캐싱 레이어 도입: FastAPI 또는 Node.js 프록시, Redis, Ollama 조합으로 작게 시작합니다.

- 트래픽 큰 엔드포인트부터 혼합 적용: FAQ, 요약, 코드 설명처럼 쉬운 요청부터 로컬 LLM으로 옮깁니다.

실전 적용 체크리스트

- LLM 프록시를 도입했는가

- LLM 캐싱 레이어를 넣었는가

- 태스크 분류 표를 만들었는가

- 모델 라우팅 규칙을 문서화했는가

- 비용 모니터링 대시보드를 만들었는가

- 프롬프트·컨텍스트 최적화를 적용했는가

- 폴백 전략과 예산 상한을 정했는가

다음 단계는 실제 구현입니다. 언어별 프록시 SDK, Claude API와 로컬 LLM을 함께 감싸는 공통 인터페이스, 더 정교한 AI 라우터까지 확장하면 운영 효율은 더 좋아집니다.

자주 묻는 질문 (FAQ)

클로드 API + 로컬 LLM 혼합 아키텍처는 어떤 서비스에 가장 잘 맞나요?

반복 질문이 많고, 요청 난도가 크게 나뉘며, 일부만 고품질 추론이 필요한 서비스에 잘 맞습니다. 고객센터, 교육 챗봇, 코드 리뷰, 문서 요약, 콘텐츠 변환 서비스가 대표적입니다.

캐시만 도입해도 비용 절감 효과가 큰가요?

네. FAQ, 정책 안내, 반복 요약처럼 재사용 가능한 요청이 많다면 캐시만으로도 Claude 호출을 크게 줄일 수 있습니다. 특히 동일하거나 유사한 질문이 자주 들어오는 서비스에서는 가장 먼저 적용할 가치가 큽니다.

로컬 LLM을 쓰면 품질이 너무 떨어지지 않나요?

모든 작업에 로컬 LLM을 쓰면 품질 문제가 생길 수 있습니다. 하지만 단순 요약, 라벨링, FAQ 응답, 초안 작성처럼 비교적 쉬운 작업에만 제한하면 충분히 실용적입니다. 중요한 것은 태스크를 잘 나누고, 고난도 작업은 Claude에 맡기는 것입니다.

프록시는 꼭 필요한가요?

장기적으로는 거의 필수에 가깝습니다. 프록시가 있어야 캐시, 라우팅, 예산 상한, 민감정보 마스킹, 로그 수집을 중앙에서 통제할 수 있습니다. 서비스 코드가 직접 Claude API를 호출하는 구조는 운영이 커질수록 비효율적입니다.

정말 50~80%까지 절감할 수 있나요?

가능하지만 모든 서비스가 같은 수준으로 줄어드는 것은 아닙니다. 반복 요청 비율, Claude 의존도, 응답 길이, 캐시 히트율, 로컬 모델의 적합성에 따라 차이가 큽니다. 다만 Claude 비중 축소, 캐시 도입, 프롬프트 단축이 함께 적용되면 높은 절감 폭을 기대할 수 있습니다.

출처 및 참고자료

- 내부 자료

“클로드 API 로컬 LLM 혼합 아키텍처로 비용 50 80 절감하기”에 대한 2개의 생각